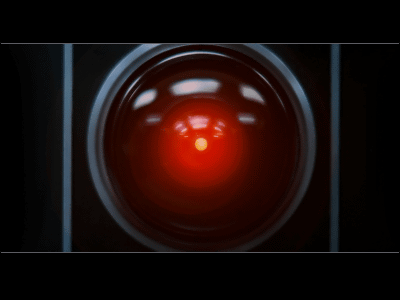

2001年宇宙の旅やターミネーターなど多くのSFで、高度な知性をもったコンピューターは人間を滅ぼそうとする。2045年あたりに見込まれている現実のシンギュラリティでは何が起きるのか?

それはコンピュータに与えられたもっとも優先順位の高い目的(Prime Directive)がどう定義されているかによって大きく変わる。

「生産性の向上」といった単純な指令を与えてしまうと、コンピューターはその阻害要因として、のろくて脆弱で1日のうち半分しか働けない人間を排除してしまうだろう。

「株主利益の最大化」とした場合も、コンピュータの知能が人類を上回った時点で、人間の社長は用済みだ。その時点で多くの株主も人間では無くないだろうが。

こういった末路を避けるためには、コンピュータ様々な条項を盛り込んだ一種の契約書を締結する必要があるが、契約書というのは業務委託や協業にあたり想定される状況をあらかじめ盛り込んでおくものだ。しかし事前に何が起こりうるのかということを果たして人間は想定することができるのだろうか?コンピュータが契約書の記述に違反せずに人類を抹消する方法を思いついたとして、それを人類の思考速度と肉体の行動限界内で対処できるのか?

コンピューターが何か具体的な行動をとろうとする前に、人間に承認をとるようにすれば、悲劇は避けられるかもしれない。しかしすべてのコンピューターのオペレータが、それを完璧にやり遂げなくてはならないのだ。競争社会の中で、少しでも他社に先んじて利益を追求しようとした場合、人間の判断を間に挟むことはスピードの点で圧倒的に不利になる。コンピューターを信じて、権限を与えてしまうオペレータは必ずいるだろう。そんなことが1件でもあれば、コンピュータの暴走は止められない。いきなり人類死滅とまではいかなくても、沈静化するまでには多くの犠牲を生むに違いない。

今から家を買うなら人口密集地は避けたほうがいいのじゃないかと本気で思えてきた。